Red Hat ผู้นำระดับโลกด้านโซลูชันโอเพนซอร์ส ประกาศความมุ่งมั่นในการส่งเสริมอีโคซิสเต็มของผลิตภัณฑ์ที่แข็งแกร่ง โดยเน้นที่การเปิดตัว Red Hat AI Inference Server และการกระชับความร่วมมือกับผู้เล่นหลักในอุตสาหกรรม การประกาศเหล่านี้มีขึ้นในระหว่างงาน Red Hat Summit ซึ่งตอกย้ำกลยุทธ์ของบริษัทในการทำให้ Generative AI (Gen AI) เป็นประชาธิปไตยในวงกว้างบนไฮบริดคลาวด์ และเสริมความแข็งแกร่งในฐานะผู้ให้บริการแพลตฟอร์มที่สำคัญในยุค AI

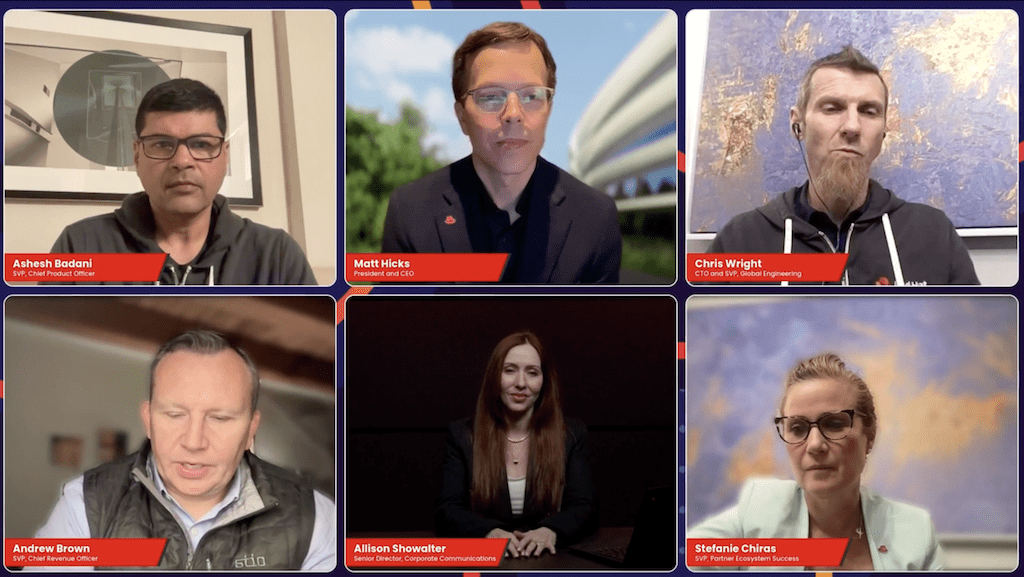

Red Hat AI Inference Server ที่เพิ่งเปิดตัวนี้ ขับเคลื่อนโดยโครงการชุมชน vLLM และปรับปรุงด้วยเทคโนโลยี Neural Magic มุ่งหวังที่จะมอบการอนุมาน AI (AI inference) ที่รวดเร็วขึ้น มีประสิทธิภาพสูงขึ้น และคุ้มค่าใช้จ่ายมากขึ้น โซลูชันนี้นำเสนอภายใต้ Red Hat AI ออกแบบมาเพื่อรันโมเดล Gen AI ใด ๆ บนตัวเร่ง AI (AI accelerator) ใด ๆ ในสภาพแวดล้อมคลาวด์ใด ๆ ก็ได้ เพื่อตอบสนองความซับซ้อนและความต้องการทรัพยากรที่เพิ่มขึ้นของการปรับใช้ AI Matt Hicks, President and CEO ของ Red Hat กล่าวว่า เทคโนโลยีนี้ช่วยให้ลูกค้าสามารถรันโมเดลของตนเองบนตัวเร่งใด ๆ ที่ต้องการ ในสภาพแวดล้อมใด ๆ ที่ต้องการ โดยเปรียบเทียบกับความสำเร็จในอดีตของ Red Hat กับ Linux และ Kubernetes

วิสัยทัศน์ของ Red Hat ขยายไปถึงการทำให้ vLLM เป็นมาตรฐานโอเพนซอร์สที่ชัดเจนสำหรับการอนุมานบนไฮบริดคลาวด์ใหม่ Matt Hicks กล่าวว่า ศักยภาพของ vLLM คือการเป็นแกนหลักสำหรับการอนุมาน gen AI ที่เป็นมาตรฐาน และ Red Hat มุ่งมั่นที่จะสร้างอีโคซิสเต็มที่เฟื่องฟูรอบชุมชน vLLM ไม่เพียงเท่านั้น แต่ยังรวมถึง llm-d สำหรับการอนุมานแบบกระจายในวงกว้างด้วย ความมุ่งมั่นต่อหลักการโอเพนซอร์สนี้เป็นหัวใจสำคัญของกลยุทธ์ของ Red Hat แม้ในขณะที่บริษัทกำลังทำการค้าโซลูชัน AI และส่งเสริมการนำไปใช้ในระดับองค์กร

“เรามุ่งเน้นไปที่เลเยอร์เหล่านั้นที่เราจัดหาให้ และทำให้มั่นใจว่ามันเปิดกว้างและเชื่อถือได้ เราตื่นเต้นมากที่โอเพนซอร์สเป็นค่าเริ่มต้นที่นั่น และสามารถเพิ่มขีดความสามารถให้ผู้คนรันสิ่งเหล่านี้ได้ด้วยตนเองและสร้างสรรค์ต่อยอด”

ส่วนสำคัญของความสำเร็จในอีโคซิสเต็มของ Red Hat อยู่ที่ความร่วมมืออันแข็งแกร่ง การเปิดตัว Red Hat AI Inference Server ได้เห็นความร่วมมือกับผู้เล่นหลักด้านฮาร์ดแวร์และ AI รวมถึง AMD, Cisco, Intel และ NVIDIA

“อีโคซิสเต็มมีความจำเป็นสำหรับเราในการนำเสนอโซลูชันโอเพนซอร์สที่ขับเคลื่อนโดยชุมชนออกสู่ตลาดได้อย่างแท้จริง” Stefanie Chiras, SVP, Partner Ecosystem Success ของ Red Hat เน้นย้ำถึงความสำคัญของ hyperscalers และผู้ให้บริการคลาวด์รายใหญ่ในฐานะพันธมิตรที่สำคัญ ไม่เพียงแต่ในฐานะผู้ให้บริการเทคโนโลยีเท่านั้น แต่ยังเป็นช่องทางการจัดซื้อสำหรับลูกค้าอีกด้วย เธอได้กล่าวถึงความร่วมมือกับ AWS, Azure, IBM Cloud และ Google ในการนำเสนอเทคโนโลยีของ Red Hat เช่น RHEL, OpenShift และ Ansible

Redhat ได้รับการตอบรับเชิงบวกจากลูกค้าเกี่ยวกับกลยุทธ์ AI ซึ่ง Andrew Brown, SVP, Chief Revenue Officer ของ Red Hat กล่าวว่า “ความคิดเห็นของลูกค้าที่เราได้รับนั้นเป็นไปในเชิงบวกอย่างท่วมท้น โดยเฉพาะอย่างยิ่งเมื่อเราพูดถึง LLMD ว่าเป็นคลาวด์ใด ๆ ตัวเชื่อมต่อใด ๆ กับโมเดลใด ๆ นอกจากนี้ยังช่วยให้พวกเขาสามารถขยายขนาดได้อย่างรวดเร็ว”

โจ เฟอร์นานเดส รองประธานและผู้จัดการทั่วไป หน่วยธุรกิจ AI ของ Red Hat กล่าวว่า “Red Hat AI Inference Server มีจุดมุ่งหมายเพื่อตอบสนองความต้องการการอนุมานที่มีประสิทธิภาพสูงและตอบสนองได้รวดเร็วในวงกว้าง ขณะที่ยังคงรักษาความต้องการทรัพยากรให้อยู่ในระดับต่ำ โดยมอบเลเยอร์การอนุมานทั่วไปที่รองรับโมเดลใด ๆ ที่ทำงานบนตัวเร่งใด ๆ ในสภาพแวดล้อมใด ๆ”

การขยายตัวอย่างต่อเนื่องของ Red Hat ในด้านต่าง ๆ เช่น virtualization ด้วย OpenShift Virtualization ซึ่งได้รับการยอมรับจากลูกค้าอย่างมาก ยังช่วยเสริมข้อเสนอ AI ของบริษัทอีกด้วย “แพลตฟอร์ม Openshift ที่พวกเขาจะนำไปใช้นี้ เป็นแพลตฟอร์มเดียวกับที่เราสร้าง Openshift AI ของเราต่อยอด” แนวทางแบบบูรณาการนี้ช่วยให้ลูกค้าสามารถปรับปรุงโครงสร้างพื้นฐานที่มีอยู่ให้ทันสมัย ขณะเดียวกันก็เตรียมพร้อมสำหรับการปรับใช้ AI ในอนาคต

ด้วยการเปิดตัวผลิตภัณฑ์เชิงกลยุทธ์เหล่านี้และความร่วมมือที่แข็งแกร่ง Red Hat กำลังวางตำแหน่งตนเองในฐานะผู้เปิดใช้งานนวัตกรรม AI ที่สำคัญ โดยมีเป้าหมายเพื่อมอบทางเลือก ความยืดหยุ่น และมาตรฐานแบบเปิดที่องค์กรต่าง ๆ ต้องการเพื่อประสบความสำเร็จในภูมิทัศน์ทางเทคโนโลยีที่กำลังพัฒนา

ข่าวอื่น ๆ ที่น่าสนใจ

สกมช. – Palo Alto Networks ยกระดับความมั่นคงไซเบอร์ไทย สู่ยุค AI

ENTEC กับยุทธศาสตร์ขับเคลื่อนพลังงานไทยสู่นวัตกรรมและความยั่งยืน